Acum câțiva ani, când vorbeam despre inteligența artificială (AI), ne-am gândit la roboți sau programe capabile să execute sarcini automat. În zilele noastre, în termeni simpli, Această tehnologie permite computerelor să recunoască tipare în cantități mari de informații și să genereze conținut nou.: text, imagini, audio sau chiar video care pot părea a fi reale.

Problema este că aceeași tehnologie este folosită și pentru fraudă. Și nu este science fiction: În Columbia există deja cazuri în care oamenii au pierdut bani după ce au primit apeluri cu voci clonate, videoclipuri false sau mesaje extrem de convingătoare generate de inteligența artificială. Tehnologia care era rezervată anterior pentru laboratoare este acum disponibilă oricui are o conexiune la internet, ceea ce a schimbat peisajul fraudei digitale.

CITEȘTE ȘI

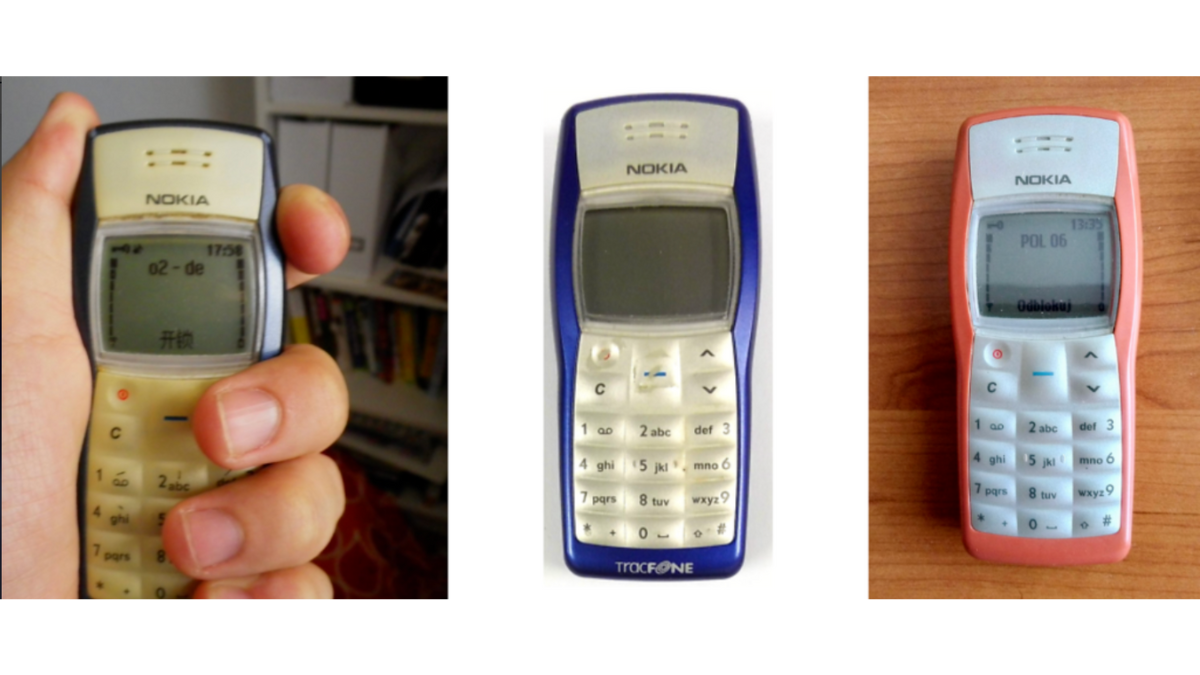

Nokia 1100: de unde să-l cumpăr și câte zile ține bateria?

Maria Salas Valencia

Vocea și videoclipul sunt replicabile

Una dintre cele mai răspândite farse este clonarea vocii. Cu câteva secunde de sunet – care poate fi obținut dintr-un videoclip de pe rețelele sociale, o notă vocală sau chiar un apel înregistrat–, criminalii pot genera o replică aproape identică a vocii unei persoane.

Scenariul este de obicei același: un apel urgent cu scripturi similare cu acestea: — Mamă, am avut un accident. „Sunt reținut, vreau să faci un fir acum” sau „Mi-a fost furat telefonul mobil, acesta este noul meu număr.”

Tonul este chinuit, vocea se simte reală, povestea este coerentă. Și în câteva minute victima face transferul. Inteligența artificială nu doar copiază timbrul vocii; De asemenea, poate imita pauze, accente și emoții. Dacă este combinată cu informațiile obținute din rețelele de socializare – călătorii, membri ai familiei, locuri frecventate de o persoană – înșelăciunea devine și mai credibilă.

Inteligența artificială este capabilă să imite accentul, pauzele și emoțiile victimelor înșelătoriei. Fotografie:iStock

Aceste farse pot include și imagini cu deepfake, care sunt videoclipuri manipulate folosind inteligența artificială care permit înlocuirea feței unei persoane sau schimbarea vocii. În acest sens, În zilele noastre este posibil să creați un videoclip fals în care, de exemplu, un „șef” solicită o plată urgentă, un presupus funcționar dă instrucțiuni sau o persoană publică promovează o investiție frauduloasă.

CITEȘTE ȘI

Apple lansează Age Verification API Beta și va restricționa aplicațiile pentru persoanele peste 18 ani: disponibil pe iOS, iPadOS și macOS

Maria Salas Valencia

Deși există adesea mici detalii care dezvăluie manipularea – mișcări ciudate ale feței sau sincronizarea imperfectă a buzelor – acestea nu sunt întotdeauna evidente pentru utilizatorul obișnuit, mai ales dacă mesajul vine într-un moment de presiune.

Pe de altă parte, În Columbia, WhatsApp continuă să fie canalul ales pentru escroci. Dar, spre deosebire de înainte, acum multe dintre aceste mesaje nu mai sunt scrise prost sau au erori evidente deoarece inteligența artificială ne permite să generăm texte personalizate și coerente.

În Columbia, WhatsApp continuă să fie canalul ales pentru escroci Fotografie:iStock

Infractorul poate analiza informații publice despre victimele sale pe rețelele de socializare și poate construi un mesaj aproape pe măsură: “Bună Carlos, am văzut că ați făcut o achiziție recentă. Trebuie să confirmăm plata înainte de expediere.”

Numele potrivit, contextul potrivit și momentul potrivit îl fac pe victimă să coboare garda. Unele fraude combină mai multe tehnici: un mesaj sosește primul; apoi, un apel cu o voce clonată și, în final, un link fals pentru a finaliza plata.

De ce sunt aceste tipuri de fraude atât de periculoase? Pentru că atacă ceva fundamental: încrederea. De ani de zile am fost învățați să ne ferim de e-mailurile scrise prost sau de numerele necunoscute, dar acum frauda poate arăta perfect, poate fi reală și poate fi bine scrisă.

CITEȘTE ȘI

Cele cinci probleme sociale care vor marca agenda și dezbaterea publică în America Latină în 2026: inegalitatea, securitatea și bunăstarea vor fi axele

Andrés Bejarano Bejarano

În plus, inteligența artificială ajută la automatizarea atacurilor un escroc poate trimite mii de mesaje personalizate în câteva minute. Și dacă doar un mic procent de oameni cad, frauda este profitabilă.

Având în vedere aceste riscuri, există mai multe măsuri care vă vor permite să fiți mai în siguranță, dar dacă ați fost deja victima uneia dintre aceste escrocherii, amintiți-vă că Acționarea rapidă este esențială. Cu cât acționați mai repede, cu atât sunt mai mari șansele de a limita daunele.

În aceste cazuri, este important să vă contactați imediat bancablocarea transferurilor pe care le pot face infractorii; raportează numărul escrocului pe WhatsAppraportați incidentul la Poliția Națională (Centrul Cibernetic al Poliției) și schimbați parolele.

În cele din urmă, să ne amintim că AI nu este un inamic, este un instrument puternic cu beneficii pentru educație, sănătate și productivitate. Problema nu este tehnologia, ci utilizarea ei dăunătoare. Într-o lume în care vocea poate fi falsificată și video manipulat, cea mai bună apărare rămâne aceeași: gândiți-vă înainte de a reacționa, verificați înainte de a transfera și nu acționați niciodată sub presiune.

CITEȘTE ȘI

OpenAI anunță lansarea unui difuzor cu inteligență artificială pentru 2027: va avea o cameră pentru a recunoaște fețele și obiectele

Maria Salas Valencia

Măsuri pentru a te proteja

În timp ce tehnologia evoluează, există măsuri simple care continuă să funcționeze și vă pot ajuta să vă protejați de escrocherii bazate pe inteligență artificială:

– Aveți grijă de urgența emoțională: Majoritatea fraudelor se bazează pe frică sau grabă. Dacă un mesaj sau un apel vă solicită să luați măsuri „imediat”, opriți-vă.

– Închideți și sunați înapoi: Dacă primiți un apel suspect de la un membru al familiei, închideți și sunați direct la numărul pe care l-ați salvat deja.

– Creați un cuvânt cheie familiar: Fii de acord cu familia ta asupra unui cuvânt pe care îl poți folosi în situații de urgență. Dacă persoana care vă sună sau vă scrie nu cunoaște acel cuvânt, nu faceți niciun transfer.

– Nu partajați sunet inutil pe rețelele sociale: Cu cât mai mult audio și video sunt disponibile pentru public, cu atât va fi mai ușor pentru un infractor să antreneze un model de clonare a vocii.

– Activați verificarea în doi pași: pe WhatsApp, prin e-mail și pe conturile tale de socializare.

– Nu furnizați coduri de verificare: Nicio entitate serioasă nu vă va cere un cod care ajunge prin SMS.

– Verificați înainte de a face investiții: Dacă vedeți un videoclip cu o persoană publică care recomandă o investiție, confirmați informația în mass-media oficială.

Ph. D. Specialist în securitate cibernetică. Urmăriți toate informațiile despre tehnologie Facebook ŞIStare de nervozitate

URL-ul a fost copiat în clipboard

Proiect de încredere logo

Aflați mai multe